MAÎTRISER PAR LE CALCUL MASSIF LE TSUNAMI DU NUMÉRIQUE

Une production exponentielle des données, indispensable à valoriser

L’augmentation fulgurante des flots de données générés par les grands instruments, les systèmes et les objets intelligents submerge notre environnement quotidien. A l’horizon 2020, ce seront au plan mondial plus de 50 milliards de systèmes connectés qui auront produit plus de 40 000 milliards de milliards de données, soit autant d’octets que d’étoiles dans l’univers. Cette masse inimaginable d’informations, largement hors de portée de l’analyse humaine, serait inutilisable si les technologies permettant d’analyser, de transformer et d’extraire les « pépites » de ces amas de données n’avaient progressé au même rythme.

L’accès instantané à l’information pertinente d’une organisation gouvernementale, d’une entreprise, voire du citoyen est devenu le moteur d’une compétition mondiale acharnée pour développer les technologies avancées du HPDA1, à la confluence du traitement massif des données et du calcul haute performance. Ces technologies sont essentielles pour favoriser la compétitivité des entreprises, à travers les gains de productivité permis par la simulation, leur capacité d’innovation et l’augmentation de la qualité des produits qu’elles permettent.

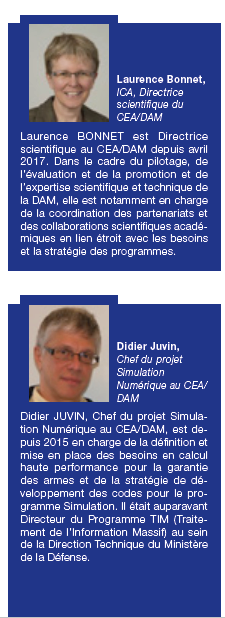

Le supercalculateur Cobalt d'ATOS-Bull (1.5 PFlops) destiné aux besoins de l’industrie et hébergé au TGCC

Enjeu de souveraineté pour un Etat et de compétitivité pour l’industrie, le développement du HPDA nécessite un effort soutenu et continu de Recherche et Développement, dans un paysage mondial où seuls les USA, la Chine, le Japon et la France sont capables de concevoir et produire des supercalculateurs compétitifs, en maîtrisant les maillons essentiels de la chaîne de valeur.

Cette maîtrise nationale est primordiale pour trois raisons principales :

• Parer le risque permanent d’embargo sur les composants clés (en 2015, le congrès américain a décidé d’interdire l’export vers la Chine de composants dédiés au calcul intensif) ;

• Maîtriser la sécurité et éviter le risque de backdoors2 sur les composants matériels ou logiciels ;

• Anticiper le développement de nouvelles applications capables d’exploiter efficacement les architectures de la génération de supercalculateur en cours de conception.

Les programmes nationaux menés aux USA, en Chine et au Japon sont globaux ; ils comportent à la fois de la R&D technologique, la conception et la réalisation de supercalculateurs pour les besoins publics, et le développement de l’écosystème applicatif associé.

En France, l’Etat a décidé de mettre en place une politique volontariste autour du numérique et de la donnée. A ce titre, il a multiplié les initiatives et mis en oeuvre une stratégie de soutien au développement industriel en adéquation avec l’objectif : loi pour une République Numérique, Mission gouvernementale sur l’Intelligence Artificielle de Cédric Villani, mise en place d’une solution industrielle « Economie de la Donnée », Plan National Supercalculateur de la Nouvelle France Industrielle. Constatant que tous secteurs confondus, les applications utilisant les supercalculateurs sont devenus des moteurs indispensables de performance et de compétitivité des entreprises impactant de manière significative la croissance et l’emploi, il a fixé

comme objectif prioritaire la maîtrise nationale des technologies de l’exascale3 à l’horizon 2020.

Le CEA coordonne un écosystème pour le calcul haute-performance et le traitement massif des données

Le CEA est totalement impliqué dans la stratégie nationale et européenne du HPDA. Ainsi, pour garantir une offre industrielle compétitive, pérenne et souveraine dans ces domaines, il a bâti depuis plus de 10 ans un écosystème industriel et académique, reposant sur 3 piliers :

1 - les technologies matérielles et logicielles, qui incluent la R&D et la conception de supercalculateurs ;

2 - les grandes infrastructures, qui comprennent les ordinateurs et les centres de calcul ;

3 - les applications, qui englobent les projets de simulation, les développements applicatifs et les formations nécessaires pour utiliser ces machines.

Ainsi, le CEA/DAM a initié avec un ensemble d’industriels la technopole européenne de compétence en simulation numérique Ter@ tec, chargée de promouvoir l’ensemble de la chaîne de valeur du Calcul Haute performance et de positionner la France comme un des principaux acteurs mondiaux dans ce domaine. Ter@tec est constituée d’un campus accueillant des entreprises et des laboratoires mixtes industrie-recherche situé à Bruyères-le-Châtel en Essonne (91), à proximité immédiate du centre DAM/Ile-de-France, et d’une association comprenant plus de 80 membres académiques et industriels.

Le complexe de calcul scientifique du CEA/DAM Ile-de-France est l’un des plus puissants au monde, au service de la Défense, de l’industrie et de la recherche. Il comprend tout d’abord la grande infrastructure de la DAM, réservée aux programmes de Défense qui héberge le supercalculateur TERA1000, de technologies ATOS/Bull, ainsi que deux grandes infrastructures au sein du Très Grand Centre de Calcul (TGCC) du CEA :

- La première, destinée aux besoins de la recherche académique, héberge la machine de 9 PFlops : Joliot-Curie d’ATOS/Bull accessible aux organismes de recherche nationaux et européens, via GENCI (Grand Equipement National de Calcul Intensif) et PRACE.

- La seconde, destinée essentiellement aux besoins de l’industrie, héberge la machine de 2 PFlops Cobalt d’ATOS/Bull au Centre de Calcul Recherche et Technologie (CCRT) du CEA. Elle hébergera prochainement un des simulateurs quantiques les plus performants au monde, développé par ATOS, l’ATOS QLM ; ce simulateur permettra aux partenaires du CCRT d’expérimenter des technologies de rupture afin de mieux maitriser l’évolution de leurs applications et de relever les défis associés à la simulation numérique, le Big Data ou encore l’Intelligence artificielle et le « Machine Learning ».

Ter@tec et le CCRT fédèrent une expertise de haut niveau à travers des projets industriels dans des domaines variés (énergie, automobile, aéronautique, moteur, matériaux, cosmétique, santé…).

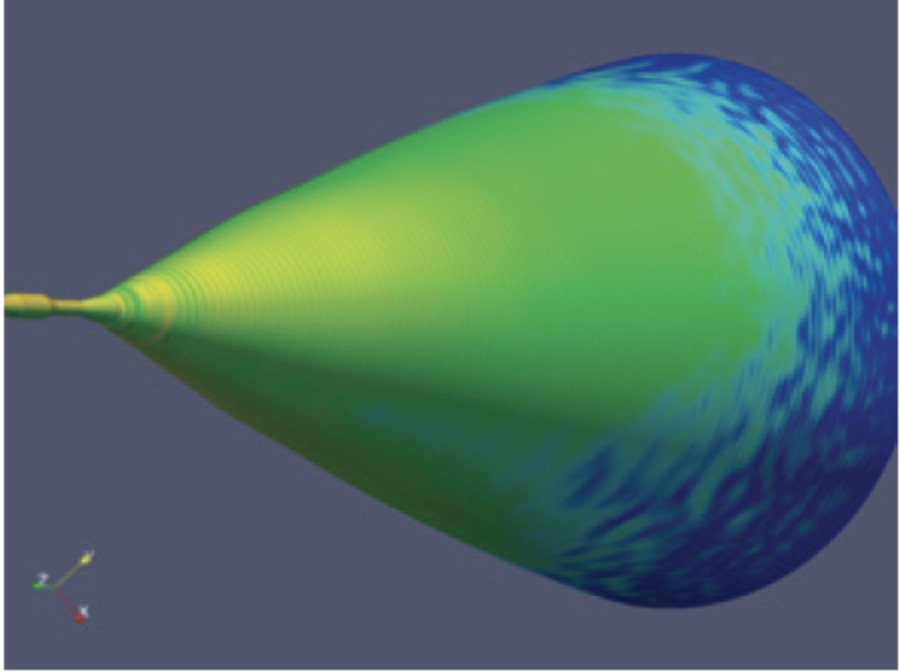

Simulation réalisée au CCRT du courant de surface sur un radôme de pointe avant d’avion de combat (courtesy from Thales).

Une démarche reconnue et stimulée au plus haut niveau de l’Etat

Fort du succès de cette démarche, le CEA a reçu de l’Etat la mission nationale de développer les technologies pour « disposer à l’horizon 2020 de la capacité industrielle de concevoir et réaliser des calculateurs de classe exaflopique de manière durablement compétitive ». Ce programme de co-design, mené par le CEA/DAM avec ATOS/Bull dans le cadre d’un partenariat de R&D, a pour ambition de porter l’industriel français dans le Top 3 mondial des fabricants de supercalculateurs.

« LE COMPLEXE DE CALCUL SCIENTIFIQUE DU CEA DAM ILE-DE-FRANCE EST L’UN DES PLUS PUISSANTS AU MONDE »

Ces technologies très performantes profitent directement à l’industrie et à l’ensemble des domaines de recherche du CEA : Défense, énergies nucléaire et renouvelable, recherche fondamentale et recherche technologique, en leur permettant d’être en première ligne pour les exploiter dans une boucle vertueuse de création de valeur allant de la recherche à l’industrie.

Le HPDA permet en effet de prédire le comportement de systèmes complexes à partir de l’observation et de l’analyse du passé. L’analyse massive de données disponibles permet d’élaborer des modèles simplifiés (boite noire) de processus ou de phénomènes complexes, construits par apprentissage automatique. Ces modèles, de par leur capacité à généraliser au-delà du domaine observé, ouvrent un potentiel considérable d’innovations. Cependant, de nombreux travaux sont encore nécessaires pour transformer cette perspective en véritable outil d’aide à la décision et notamment, pour expliciter les cheminements produisant les résultats obtenus à partir de modèles statistiques.

Dans ce cadre, le List, institut de CEA Tech, conçoit des algorithmes et des outils logiciels pour traiter et analyser une grande variété de données très volumineuses et complexes issues d’appareils de mesure (biologie, industrie agroalimentaire, contrôle de procédé…) ou de réseaux de capteurs (bâtiments, équipements industriels, véhicules…), basés sur l’apprentissage automatique de modèles statistiques, qui permettent de développer des outils d’analyse de résultats ou d’aide à la décision.

Ces nouvelles méthodes pourraient impacter les systèmes sociétaux entiers qui sauront en tirer profit. Citons par exemple la santé avec la possibilité de déployer à large échelle une médecine plus personnalisée et préventive, la conception et la gestion de systèmes urbains avec l’optimisation de la mobilité des biens et des personnes, l’optimisation de la consommation énergétique. Le prérequis à ces méthodes est un accroissement continu des capacités de calcul et de traitement de données, l’atteinte de l’exascale à l’horizon 2020 constituant une étape importante.

1 : HPDA : High Performance Data Analytics, peut se traduire par Analyse de données par le calcul haute performance

2 : Porte dérobée, fonctionnalité d’un programme inconnue par l’utilisateur légitime qui procure un accès secret au système

3 : 1 ExaFlops, un milliard de milliards d’opérations flottantes double précision par seconde

Aucun commentaire

Vous devez être connecté pour laisser un commentaire. Connectez-vous.