L’HUMANITÉ DOIT RESTER AUX COMMANDES DE L’IA

Les avancées de l’IA surprennent. Ses applications semblent déborder le fleuve de spéculations intellectuelles qui la précédait. L’effet de sidération ne doit pas éclipser le principe que l’humanité reste aux commandes.

L’histoire est ponctuée d’erreurs de jugement sur l’évolution future des ordinateurs.

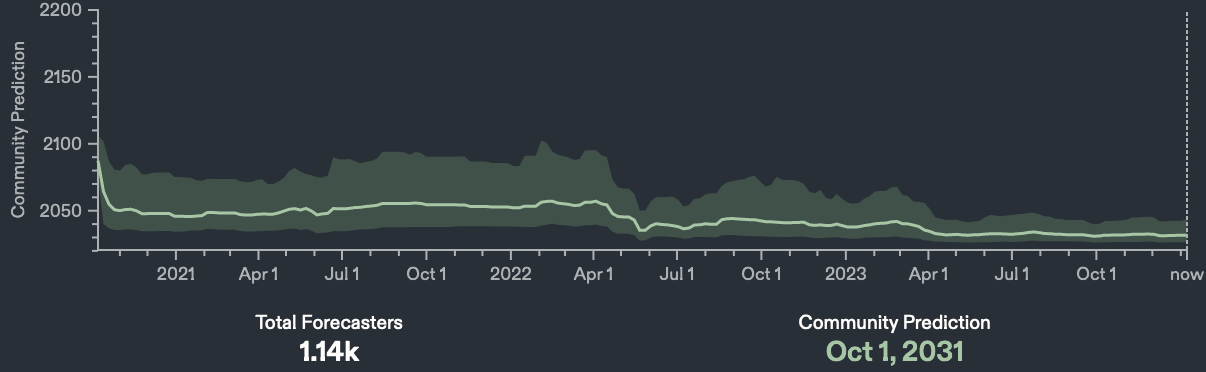

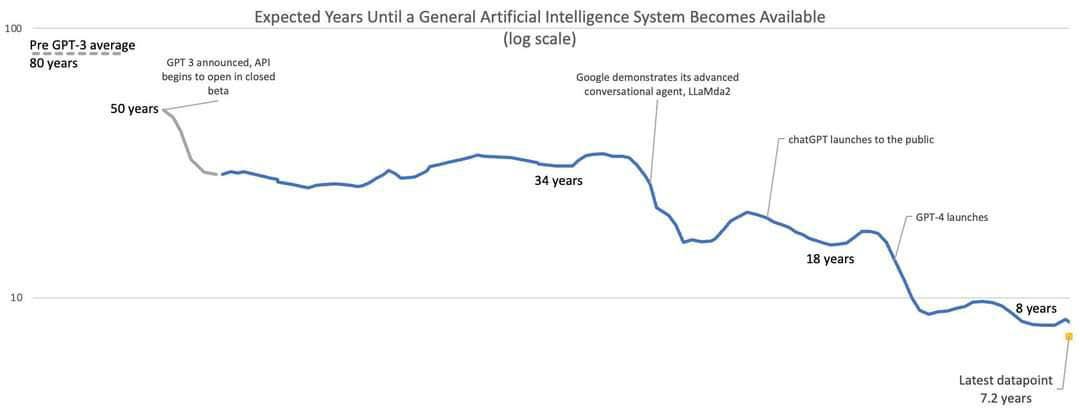

Le ver est dans le fruit depuis la rivalité entre chapelles symbolique (Minsky et Papert, qui pensaient que dans l’IA à venir il faudrait tout comprendre, et donc que ce serait extrêmement lent) et connexionniste (Rosenblatt, qui pensait que la machine se construirait toute seule), ce qui a altéré la politique de recherche américaine au détriment de la seconde… 50 ans plus tard, on remarque que le coût d’entraînement d’un système d’apprentissage profond ne diminue pas d’un facteur 2 tous les 18 mois, mais de 10 par an, ce qui pulvérise la loi de Moore et oblige à suivre l’évolution de l’IA presque chaque mois. Des experts envisageaient le « seuil fatidique » de l’IA Générale (AGI) quelque part entre 2040 et 2100. On annonce désormais 2030 !

Soit, mais une IA dite Générale rivalisera-t-elle vraiment avec le cerveau humain ? Rien n’est moins sûr en ce qui concerne la faculté d’adaptation au monde réel, qui regorge de situations inattendues. Certains experts doutent que cela arrive. Pour l’heure il y a urgence à réduire le taux d’erreur ou d’hallucinations et le risque de contournement des verrous placés pour niveler une partie des biais. Et même avec cela, qui confiera les clés de sa maison à une IA vantée comme générale par Mark Zuckerberg ?

Temps restant estimé avant l’arrivée d’une IA Générale, en échelle log, selon des sondages 2021-2023 (source : ARK invest)

Il faut prendre le temps de la réflexion éthique… et il faut le faire vite !

L’IA a déjà franchi plusieurs points de non-retour : Travailler sans IA générative ? L’Italie a voulu bannir ChatGPT pendant un mois. Une entreprise de services qui voudrait s’en passer serait laminée par la concurrence.

Poser un moratoire ? Elon Musk et quelques autres n’y sont pas parvenus...

L’IA est déjà quasiment partout, impactant tous les métiers. Les exceptions seront rares et d’un poids en PIB infime. C’est l’effet de masse. Et les systèmes d’IA fonctionneront de plus en plus en réseau.

Les grandes structures d’apprentissage ont damé le pion aux systèmes symboliques. Avec le standard ONNX on peut injecter des codes de simulation numérique dans des réseaux de neurones pour accélérer de manière vertigineuse des créations en architecture, ingénierie, médecine, cinéma, etc.

C’en est fini d’un monde sans systèmes critiques assis sur l’IA (lutte cyber, systèmes logistiques, etc.).

Les enjeux sont phénoménaux dans deux sphères : (

géo)politique : l’IA peut contribuer à sauver la planète, tout comme accélérer son implosion si aucune limite n’est posée à la cupidité comme force motrice : l’IA combinée à la blockchain permettra de commercialiser chaque molécule, nanoseconde de vie et nm3 d’espace.

économique : en 2030, le marché de l’IA sera à des dizaines de trillons d’euros, avec à la clé des gains économiques bien supérieurs.

Pour résumer :

L’IA est de plus en plus « capable » de remplacer le cerveau humain dans sa fonction raisonnante en situation bien cadrée, et par effet de masse, de décharger des structures de décision d’une partie de leur travail. Et cette dynamique accélère. Gartner prévoit que l’IA générative atteindra le plateau de productivité d’ici 2 à 5 ans ;

Mais l’IA reste tributaire de concepteurs humains qui n’ont pas surmonté leurs « réflexes archaïques », payés par des « sponsors » semblables.

Une fois l’AGI advenue, on ne reviendra pas en arrière et il faudra oublier l’idée de la modérer, sauf à ce que des règles suffisamment uniformes et intangibles soient introduites à temps.

Une IA soutenable et humaine

Pour parler d’IA soutenable, il faut d’abord préciser ce à quoi l’on tient (la vie sur Terre, des principes, des manières de vivre, etc.) que l’on souhaite voir respecter par les usages de l’IA. Tenter de le faire au niveau européen est déjà ambitieux.

L’Europe a dégagé un cadre général axé sur des principes éthiques et un socle juridique transverse assis sur la gestion du risque. C’est un pas majeur mais qu’il faut prolonger. En effet, la dimension individuelle des principes éthiques est solidement ancrée dans un cadre institutionnel, notamment juridique. C’est moins le cas pour la dimension collective qui est loin d’être saturée par des formes institutionnelles. Cela suffira-t-il ? L’éparpillement des efforts et les forces géopolitiques centripètes amènent à en douter. Le règlement européen sur l’IA sera complété par un corpus normatif qui s’enrichira d’approches permettant de progresser vers les attendus d’une IA soutenable, depuis l’amont de la création d’un système jusqu’à son utilisation, proposées notamment par le milieu académique. Mais ce sera sous l’influence de puissances économiques et politiques porteuses, le cas échéant, de repères éthiques différents des nôtres.

Au-delà de la conformité réglementaire, une IA soutenable suppose d’appréhender la confrontation entre la réalité générée par les usages et l’éthique. L’utilisateur et le développeur doivent faire preuve d’empathie à l’égard de leurs congénères confrontés aux décisions prises à travers les systèmes d’IA, et avoir le courage de positionner leurs perceptions et les finalités d’un projet d’IA dans une perspective humaine et même, plus largement, sociétale et planétaire. C’est une condition pour faire face aux travers (simplisme, cupidité, hubris) de commanditaires sans bornes.

On peut entrevoir plusieurs dimensions du facteur humain pour l’IA :

- L’explicabilité et l’interprétabilité, qui renvoient à la transparence et une profusion de recherches et de terminologies, à la recherche d’un cadre pour « l’IA responsable ». On résumera la mise en œuvre sobrement : « work in progress ».

- L’interaction « humaine » de l’IA : de remarquables avancées (interaction avec les humains, influences sociales) sont à la main des publicitaires, des médias, des manipulateurs en ligne. Mais la redoutable capacité de l’IA à cerner l’état d’esprit d’un humain se déploie sans aucune conscience de la machine : l’impératif moral repose sur l’humain, par exemple le prompteur de ChatGPT.

- Une « conscience de l’IA » comme une forme de rétroaction. Certains experts comparent par dérision ChatGPT à un perroquet électronique… pour lequel un « mot » serait des pages de texte, demain un livre, bientôt le volume de données d’un moment d’activité de cerveau humain ?

Il faut réfléchir sur les concepts d’intelligence, de conscience, d’humanité et de relation authentique. Des avancées scientifiques récentes sur les structures mentales du dauphin, du poulpe, etc. donnent une idée du défi. Encore plus loin, des théologiens envisagent la question de savoir si une IA « plus intelligente que l’homme » serait à son image ou même à celle de Dieu. Pour préparer un futur souhaitable ou du moins soutenable avec l’IA, ne faudrait-il pas imaginer, par exemple, qu’elle recèle des formes insoupçonnées d’intelligence ?

X87, carrière administrative au CEA, à la DGA et au ministère en charge de l’Industrie en recherche scientifique, management de projets technologiques et transverses. Fondateur de la société ANATASE, active dans le numérique (projets innovants, sécurité des données et d’Internet).

Aucun commentaire

Vous devez être connecté pour laisser un commentaire. Connectez-vous.